Par Lilian DAVIN, Directeur Général de CODA Systèmes

QU'EST-CE QUE LA VISION INDUSTRIELLE ?

Dans une usine de cosmétique, des milliers de boîtes métalliques filent chaque heure sur un convoyeur. Chacune doit être impeccable : pas d’éraflure, pas de choc, pas de défaut de surface. Mais qui peut en juger à un tel rythme ?

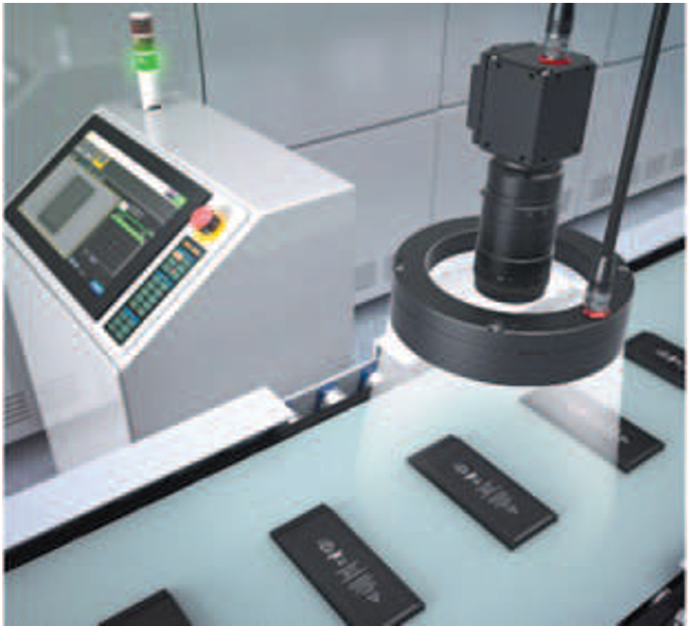

Certainement pas l’oeil humain, trop lent, trop faillible, ni les simples capteurs mécaniques. C’est là qu’entre en scène la vision industrielle : un regard artificiel, capable de détecter en temps réel l’imperfection la plus minime (Figure 1). Wikipédia la définit comme « l’application de la vision par ordinateur aux domaines industriels de production et de recherche ». Concrètement, il s’agit de caméras associées à des algorithmes, capables de voir, d’analyser et de décider. Le contrôle qualité est son domaine de prédilection, mais son champ d’application est beaucoup plus vaste : guidage de robots, assistance au process, traçabilité. Je me concentrerai ici sur le coeur du sujet : l’inspection automatisée.

Née dans les années 1980, portée par des pionniers comme Keyence (Japon), Cognex (États-Unis) ou Matrox (Canada), la vision industrielle a d’abord été une technologie d’ingénieurs pour ingénieurs. Elle s’est installée discrètement dans les ateliers, avant de connaître une véritable révolution dans les années 2010 : démocratisation des capteurs, montée en puissance des bibliothèques logicielles, diffusion des standards. Et puis, il y a quelques années, une autre révolution débarque avec fracas dans les usines : l’Intelligence Artificielle. Avec elle, une vague d’espoirs, de promesses, mais aussi de craintes, de débats et de titres racoleurs dans la presse.

DES DÉCENNIES D'ALGORITHMES "RULE-BASED"

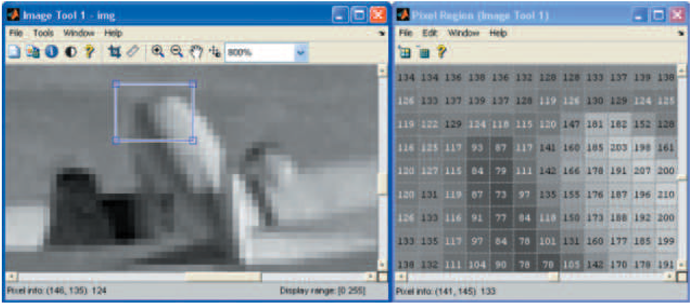

Pour comprendre ce qui se joue aujourd’hui, il faut revenir aux fondamentaux. Une caméra 2D « classique » est composée d’un capteur photosensible (CMOS ou CCD) divisé en millions de récepteurs : les pixels. Chacun mesure la lumière reçue et restitue une valeur entre 0 (noir) et 255 (blanc). Une image n’est donc rien d’autre qu’un immense tableau de nombres : cinq millions pour une caméra noir et blanc de 5 mégapixels, par exemple (Figure 2).

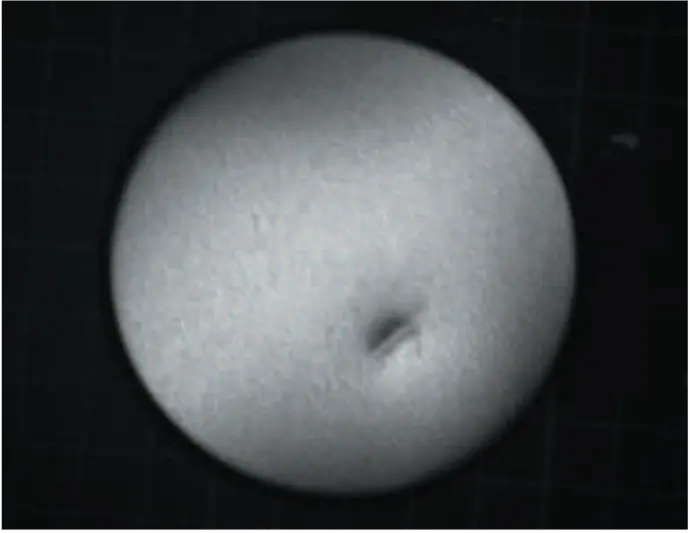

C’est notre matière première. Reste à l’analyser. Les ingénieurs ont, dès les débuts, mis au point des algorithmes déterministes, ou rule-based. On peut les ranger en deux familles : • ceux qui produisent une autre image (filtres, transformations), • et ceux qui produisent une mesure exploitable, que l’on appelle des « outils de vision » (taille de défaut, mesure de distance, verdict OK/NON-OK). Prenons un cas concret : détecter un choc sur une boîte métallique (Figure 3).

La méthode du "blob"

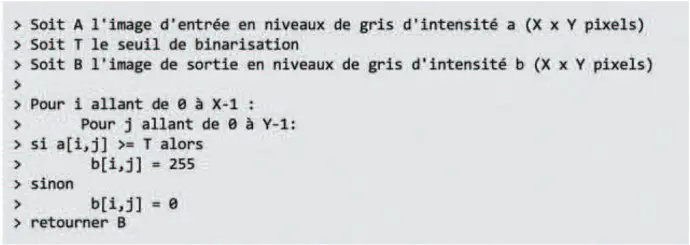

La technique la plus ancienne et la plus simple consiste à binariser l’image. On choisit un seuil, et tous les pixels plus lumineux deviennent blancs (255), tous les autres noirs (0). Résultat : une image simplifiée, noir sur blanc, où le défaut apparaît clairement.

L’algorithme de binarisation ressemble à cette séquence basique ci-dessous :

Et notre image est devenue celle-ci :

On voit très clairement notre défaut, noir sur un fond blanc. Quelques reflets sur les bords nous empêchent d’avoir un disque blanc parfait, mais nous y reviendrons.

Il reste à regrouper les pixels noirs en un « agrégat » (blob). Chaque pixel se compare à ses huit pixels voisins. Si certains d’entre eux sont noirs, ils fusionnent. Et de fil en aiguille, le défaut prend forme. En sortie, on obtient une multitude d’informations : nombre d’agrégats, position, taille, périmètre, orientation, etc. De quoi décider si la pièce est conforme ou non.

Dans notre cas, nous obtenons les résultats figurant en Figure 5.

Simple, rationnel, explicable. Mais fragile. Car le seuil est fixe : si l’éclairage change, si l’arrière-plan se complexifie, tout s’écroule.

Il est néanmoins possible de rendre ce seuil dynamique, en prenant par exemple comme seuil l’intensité moyenne de l’image (ou d’une zone), l’intensité médiane, ou même son propre calcul. On l’appelle parfois « blob adaptatif » ou « blob dynamique ».

Cependant, il existe une infinité de cas qui poseront des problèmes à cette méthode, dont la simplicité est rapidement son point limitant.

La détection par contraste

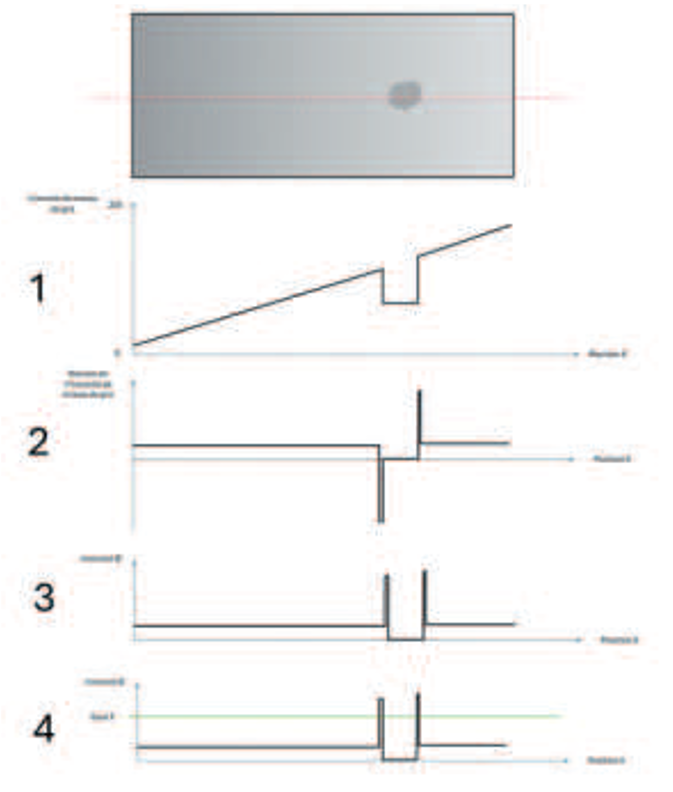

Pour dépasser ces limites, d’autres approches sont apparues. L’une des plus robustes consiste à détecter les variations locales de niveaux de gris : le contraste. Là encore, le défaut ressort, mais cette fois sans dépendre d’un seuil unique. Le principe est assez simple : on utilise la variation locale de niveaux de gris pour détecter des changements brutaux, qui correspondent aux contours de notre défaut. Les étapes sont les suivantes (Figure 6) :

- On visualise la variation de l’intensité de niveaux de gris le long d’une ligne (ligne rouge illustrée). Dans cet exemple à l’arrière-plan dégradé, il est très facile de voir à quel point il est difficile de poser un seuil fixe.

- On trace la dérivée de cette courbe, représentant les variations de ces niveaux de gris.

- On en déduit la valeur absolue, et on normalise.

- On peut alors poser un seuil sur cette courbe. Les intersections entre le seuil et la courbe correspondent au contour du défaut.

Et voilà le résultat sur notre boîte

Ces méthodes (blob, contraste et bien d’autres) constituent un arsenal puissant, toujours utilisé aujourd’hui. Leur force : elles reposent sur des règles physiques, rationnelles, traçables. Leur faiblesse : elles demandent une expertise pointue pour être paramétrées et combinées efficacement.

L'ARRIVÉE DU DEEP LEARNING

Puis l’Intelligence Artificielle a frappé à la porte des ateliers. Ou plus précisément : le Deep Learning, ou « Apprentissage Profond ».

Avant d’aller plus loin, dissipons une confusion fréquente. L’IA n’est pas une idéologie. Ni une panacée. C’est un outil. Comme le couteau, le navigateur internet ou la yaourtière. L’IA peut être utile, puissante, mais à manier avec discernement. Vous poser la question « Êtes-vous pour ou contre l’IA ? » a autant de sens que de vous demander « Êtes vous pour ou contre les couteaux ? ». Vous seriez bien embêtés. Tout dépend du contexte, de l’usage, de l’intention. Et n’oublions pas une chose évidente : un outil ne s’utilise pas tout seul. Une yaourtière, aussi sophistiquée soit-elle, ne fait jamais de bons yaourts sans quelqu’un qui sache s’en servir.

En vision industrielle, l’IA prend souvent la forme de réseaux de neurones convolutionnels appliqués à la classification d’images. L’idée : montrer au modèle une multitude d’exemples, jusqu’à ce qu’il apprenne à distinguer le bon du mauvais.

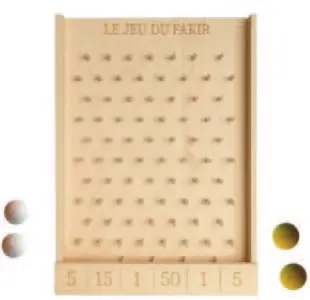

Imaginez une planche à clous, comme dans le jeu du fakir. Une bille (ou une image) tombe de case en case, rebondissant de manière chaotique, avant d’atterrir dans une boîte numérotée. Au début, tout est aléatoire. Mais à force d’itérations, le réseau ajuste ses « clous » (les coefficients internes), jusqu’à ce que les billes « bonnes » tombent dans la boîte OK, et les autres dans NON-OK (Figure 9).

La méthode d’apprentissage suit deux grandes écoles :

- Supervisé : on fournit les images déjà étiquetées (OK/NON-OK). Le modèle apprend à reproduire ces décisions.

- Non supervisé : on lâche l’algorithme sans étiquette. Il regroupe les images en familles, parfois en découvrant des anomalies inédites qu’on n’avait pas prévues.

En pratique, l’industrie utilise surtout le supervisé, car les entreprises possèdent déjà des défauthèques classées. Mais le non supervisé ouvre des perspectives fascinantes : détecter des défauts jamais rencontrés, l’inconnu total. (En clair : l’IA qui vous dit « je ne sais pas ce que c’est, mais ça ne ressemble à rien de connu »).

Quelle que soit la méthode d’apprentissage utilisée, la finalité est que l’IA peut détecter des défauts avec bien souvent un excellent taux de réussite. Mais ce procédé n’est pas exempt de fortes contraintes.

Tout d’abord, pour arriver à un résultat satisfaisant, il faut nourrir l’IA d’une quantité importante d’images, représentatives du besoin du client. Il est donc indispensable de procéder à une longue phase d’apprentissage avant de lancer le système en production, sans quoi l’IA pourra par exemple laisser passer un défaut gigantesque mais totalement absent de son cycle d’entraînement.

Ensuite, le modèle décide certes, mais sans expliquer pourquoi. Ses décisions ne reposent pas sur des règles physiques ou des seuils, mais sur des ajustements de coefficients invisibles. Comment expliquer que toutes mes billes (ou images) de « dromadaires » tombent dans la case « dromadaires » ? Parce qu’il a visiblement quatre longues pattes, une bosse sur le dos, et un teint caramel ? Absolument pas. Mais plutôt parce que les clous (coefficients) sont positionnés de telle sorte que ce soit le cas à tous les coups. Comprendre ce fonctionnement, c’est à la fois comprendre la base du Deep Learning, et ce pourquoi l’IA diffère totalement du fonctionnement de notre cerveau d’humain.

Enfin, l’apprentissage est un procédé gourmand en énergie, et il est courant d’utiliser des machines très performantes à distance (en cloud) pour l’effectuer. Cette externalisation du procédé d’entraînement peut être un frein évident pour des sociétés qui veulent un contrôle total de leurs données, et une confidentialité infaillible.

La tendance 2025 : lever les freins technologiques

Transfer learning : tricher un peu

Comme évoqué plus haut, il faut souvent des dizaines de milliers d’images pour entraîner un modèle. Grâce au transfer learning, on part d’un réseau déjà entraîné sur des millions d’images génériques, puis on l’adapte à notre application industrielle.

Résultat : quelques centaines d’images industrielles peuvent suffire à bâtir un modèle efficace. Et surtout : gain de temps, d’énergie, et éviter de transformer l’usine en laboratoire d’apprentissage pendant des mois.

Explicabilité : la clé de la réussite

Problème majeur : l’IA ne sait pas expliquer ses décisions. Mais des techniques existent pour « ouvrir la boîte noire ». Par exemple, certains modèles colorent les zones de l’image qui ont influencé la décision. Concrètement, on peut dire au client : « La pièce a été rejetée parce que l’algorithme a repéré une anomalie par ici ».

D’autres approches cherchent à analyser l’activité interne des réseaux de neurones : on constate alors que certaines couches de neurones réagissent davantage à des formes, à des textures ou à des motifs particuliers. Dans la classification d’animaux, par exemple, un groupe de neurones peut être très sensible aux rayures (et contribuer ainsi à identifier un tigre).

Ce n’est pas encore parfait, mais c’est un pas vers l’indispensable : la confiance.

Edge Learning : apprendre et décider sur place

Imaginez : au lieu d’envoyer chaque photo de votre boîte de conserve à un serveur en Californie pour savoir si elle a une rayure, la caméra réfléchit directement sur place. C’est ça, le Edge Learning : l’intelligence est embarquée dans la machine elle-même, que ce soit la caméra, l’automate ou le petit PC vissé sur le côté du convoyeur. Résultat : pas de temps perdu, pas de dépendance au réseau, pas de risque de voir vos données industrielles se balader dans le cloud. L’IA prend sa décision en millisecondes, là où ça compte : au bord de la ligne de production. Et parfois, elle peut même continuer à « apprendre » localement, en s’adaptant aux conditions réelles (température, vibrations, poussière, éclairage environnant).

Quand l’IA rencontre le rule-based : un duo efficace

S’il on veut schématiser, les algorithmes « rule-based » sont rationnels mais limités, et les réseaux de neurones sont adaptatifs mais encore mystérieux. Mais en réalité, les deux font un excellent duo quand on les marie intelligemment. L’IA peut, par exemple, s’occuper de démêler une image compliquée (bruit, reflets, textures), puis passer le relais aux bons vieux outils déterministes pour les mesures précises, les seuils et le verdict final.

C’est la complémentarité parfaite : l’un ouvre la voie, l’autre verrouille la décision. Comme dans tout bon duo de bonne vieilles séries policières, l’un est intuitif et un peu fou, l’autre est méthodique et carré… et ensemble, ils attrapent toujours le défaut.

L’esthétique, terrain de jeu de l’IA

Là où l’IA devient incontournable, c’est dans la détection de défauts dits « esthétiques ». Car l’humain lui-même hésite. Une cliente un jour me dit : « Ce défaut de logo sur ce rouge à lèvres est trop gros, il devrait passer en pièce mauvaise, mais comme c’est dans la courbe du S, et que...mais si... vous voyez… esthétiquement ça passe ». Comment traduire ce jugement subjectif en règles binaires ? Je devrais maintenant apprendre l’art et le sens de l’esthétique à un robot ? Impossible. Mais en montrant au modèle un grand nombre d’exemples validés ou rejetés par l’expérience humaine, il peut apprendre cette nuance.

L’IA se révèle donc précieuse là où les règles s’épuisent : détection sur arrièreplans complexes, défauts de texture, caractères illisibles, esthétisme flou.

Mais elle soulève une question essentielle : la confiance. Dans le nucléaire, l’automobile ou l’aéronautique, on ne peut se contenter d’un verdict opaque. Sans explication, pas de traçabilité. Et sans traçabilité, pas de progrès.

LES ENJEUX STRATÉGIQUES

L'intelligence artificielle fascine, mais l'industrie exige davantage qu'une fascination : elle réclame du sens, du concret, du fiable. On l’a vu, l’IA est un outil. C'est un outil, puissant et imparfait, capable de transformer nos processus, mais aussi de soulever des interrogations. Et dans l'univers rigoureux et rationnel de l'industrie et du contrôle qualité, l'inexplicable n'a pas sa place. Nous devons comprendre pourquoi une IA décide, pourquoi elle rejette, pourquoi elle valide. Sans explication, pas de confiance. Sans confiance, pas de véritables avancées.

Concentrons-nous sur ce qui fonctionne réellement, c'est-à-dire ce qui répond aux exigences réelles des industriels, et surtout sur ce que nous maîtrisons. En vision industrielle, la solution à un projet est parfois une IA dernier cri qui relève un défi jusqu’alors inaccessible, et parfois c'est un algorithme de traitement d'images sorti d'une vieille bibliothèque des années 90. Et c’est OK. Alors évidemment ça ne rentrera pas dans les cases actuelles des subventions européennes ou des investisseurs, mais c’est toujours le résultat du terrain qui compte et qui permet d'avoir de l'impact.

Il nous arrive d'entendre des clients nous dire : "On veut mettre en place de l'IA !" Comme si l'IA était une recette magique, qu'on saupoudre sur le process pour le rendre instantanément intelligent. Mais l'IA, c’est tout sauf de la ciboulette : elle ne se pose pas au hasard. Parfois, c'est la solution, parfois non. Et c'est justement là qu'interviennent l'expérience et les compétences des experts en vision industrielle. Parce qu'avant d'ajouter de l’IA, mieux vaut s'assurer que le plat en a vraiment besoin. Et si c’est le cas et que l’IA est la solution, alors gardons la même exigence sur le résultat.

Chez CODA Systèmes, nous retenons trois principes simples :

1. Pragmatisme

La bonne solution est celle qui fonctionne, pas celle qui brille. L’IA dernier cri peut résoudre des problèmes inédits, mais parfois la meilleure réponse est un traitement d’image robuste, éprouvé, parfaitement suffisant.

2. Clarté

Nous refusons le mystère. Une technologie n’a de valeur que si elle est comprise. C’est pourquoi nous formons nos clients : pour que chaque industriel devienne le maître de ses outils, et non l'inverse.

3. Vision globale

Un projet de contrôle qualité automatisé ne se limite pas au choix de tel ou tel algorithme utilisé. Il est essentiel de comprendre le besoin complet du client, les raisons pour lesquelles il veut mettre en place ces contrôles, le processus de fabrication du produit, ou encore l’environnement de production et ses contraintes de température, vibrations, poussière, éclairage parasite. Chez CODA, nous nous efforçons d’échanger longuement avec le client, d’analyser l’entièreté du projet, de réaliser une étude de faisabilité dans les conditions réelles de production, et de proposer une solution clé-en-main adaptée au besoin.

CONCLUSION

La vision industrielle, née de règles simples et précises, s’enrichit aujourd’hui des promesses de l’IA. Mais entre fascination et défiance, l’essentiel demeure : choisir l’outil adapté, comprendre ses décisions, et garder l’humain au centre du processus.

Par ailleurs, l’Europe ne doit pas se contenter d’importer des modèles opaques venus d’ailleurs. Des alternatives existent : IA explicables, Edge Learning, IA frugales. Soutenons-les. Car dans ce domaine aussi, l’indépendance est une condition de la maîtrise.

En conclusion, l’industrie n’a pas besoin d’illusions, mais de solutions. Et c’est peut-être là, finalement, la meilleure définition de l’IA appliquée : un outil puissant, à condition qu’il soit maîtrisé.